Главная страница Случайная страница

КАТЕГОРИИ:

АвтомобилиАстрономияБиологияГеографияДом и садДругие языкиДругоеИнформатикаИсторияКультураЛитератураЛогикаМатематикаМедицинаМеталлургияМеханикаОбразованиеОхрана трудаПедагогикаПолитикаПравоПсихологияРелигияРиторикаСоциологияСпортСтроительствоТехнологияТуризмФизикаФилософияФинансыХимияЧерчениеЭкологияЭкономикаЭлектроника

Поняття мультиколінеарності

|

|

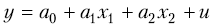

— Суть мультиколінеарності полягає в тому, що в багатофакторній регресійній моделі дві або більше незалежних змінних пов’язані між собою лінійною залежністю або, іншими словами, мають високий ступінь кореляції.

Мультиколінеарність – це поняття, яке використовується для опису проблеми, коли нестрога лінійна залежність між пояснювальними змінними призводить до отримання ненадійних оцінок регресії. Проте, така залежність зовсім необов’язково дає незадовільні оцінки. Якщо всі інші умови задовільні, тобто якщо кількість спостережень і вибіркові дисперсії пояснювальних змінних великі, а дисперсія випадкого члена – мала, то в результаті можно отримати досить позитивні оцінки.

Мультиколінеарність повинна виникати за рахунок сполучення нестрогої залежності однією (або більше) незадовільних умов, це – питання ступеня визначенності явища, а не його виду. Оцінки регресії будуть неадекватні від неї у відповідній мірі значущості. Розгляд цієї проблеми починається тільки тоді, коли вона досить суттєво впливає на результати оцінки регресії.

Ця проблема є звичною для регресії часових рядів, тобто коли значення показників складаються із рядів спостережень протягом визначеного періоду часу. Якщо дві або більше незалежних змінних мають часовий тренд, то між ними буде існувати кореляція, і це може призвести до мультиколінеарності.

Існують різні методи для зменшення мультиколінеарності. Вони діляться на дві категорії: до першої категорії відносяться методи, спрямовані на виконання умов, що забезпечують надійність оцінок регресії; до другої – відносяться використання зовнішньої інформації. Якщо з початку використовувати можливі значення показників, то, звичайно, було б важливим збільшити кількість спостережень. Якщо, наприклад, використовуються часові ряди, то це можна зробити шляхом скорочення терміну кожного періоду часу.

Якщо використовуються дані перехресної виборки і дослідник знаходиться на стадії планування дослідження, то можно збільшити точність оцінок регресії і послабити проблему мультиколінеарності за рахунок більших витрат коштів на збільшення розміру виборки та інші методи.

Найбільш поширеним способом виявлення мультиколінеарності є побудова матриці статистики, в якій відображені коефіцієнти кореляції. Незалежні показники, між якими коефіцієнт кореляції перевищує 0, 8 або 80%, розглядають на наявність мультиколінеарності.

У випадку виявлення наявності мультиколінеарності існує декілька простих шляхів її усунення. Основними серед них є наступні.

1. Вилучення змінної (або змінних) з моделі. При цьому з моделі вилучається одна із змінних колінеарної пари. Слід зазначити, що таке вилучення змінних можливе тільки у випадку, коли це не суперечить логіці економічних зв’язків. У протилежному випадку це може призвести до помилки специфікації.

2. Зміна аналітичної форми економетричної моделі. Іноді заміна однієї функції регресії іншою (наприклад, лінійної нелінійною), якщо це не суперечить апріорній інформації, дає змогу уникнути явища мультиколінеарності.

3. Збільшення спостережень. З точки зору теорії, мультиколінеарність та невелика кількість спостережень у вибірці – це одна і та ж проблема. Тому збільшення спостережень у статистичній вибірці або використання іншої статистичної вибірки може усунути, або принаймні зменшити вплив мультиколінеарності.

4. Перетворення статистичних даних. Позбутися мультиколінеарності можна і шляхом наступних перетворень вихідних даних стосовно пояснюючих змінних:

а) замість самих даних узяти їхні відхилення від середніх;

б) замість абсолютних значень даних взяти відносні значення;

в) стандартизувати змінні.

5. Використання додаткової первинної інформації. Аналіз і використання первинної додаткової інформації інколи дозволяє зняти проблему мультиколінеарності.

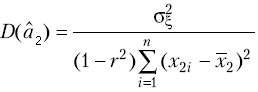

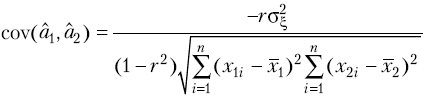

25. Вплив мультиколінеарності на оцінки параметрів моделі. (24)

Практичні наслідки мультиколінеарності

— зміщення оцінок параметрів моделі

— збільшення дисперсії та коваріації оцінок параметрів

— збільшення довірчого інтервалу

незначущість t-статистик